Datenschutzkonforme GenAI-Workflows aufbauen

Best Practices, um sensible Daten mit lokalen LLMs zu verarbeiten und regulatorische Anforderungen einzuhalten.

Datenschutzkonforme GenAI-Workflows aufbauen

Lokale LLMs versprechen maximale Kontrolle über Daten – doch nur mit klaren Prozessen und technischen Schutzmaßnahmen erfüllen sie auch regulatorische Vorgaben. Dieser Leitfaden fasst die wichtigsten Schritte zusammen, die wir in Projekten mit Banken, Versicherern und dem öffentlichen Sektor etabliert haben.

1. Datenklassifizierung und Zweckbindung

Jede Eingabe in ein Modell muss einem Zweck zugeordnet und klassifiziert werden. Empfehlenswert ist ein dreistufiges Schema (öffentlich, intern, vertraulich). Die Datenklassifizierung steuert automatisiert Maskierung, Retention und Logging.

2. Vollständige Auditierbarkeit

- Unveränderliche Logbücher (Immutable Logging): Alle Prompts, Antworten und Systemereignisse werden in manipulationssicheren Stores (z. B. WORM-Speicher) abgelegt.

- Nachvollziehbare Modelle: Versionierung über Model Registry, inklusive Commit-Hashes, Quantisierungsparameter und Evaluationsergebnisse.

- Rechtsabteilungen einbinden: Jeder neue Anwendungsfall erhält ein angewandtes Datenschutz-Review mit dokumentierter Risikoabwägung.

3. Technische Maßnahmen

- Netzwerksegmentierung am Edge: Inferenzen laufen in gesicherten VLANs oder Mikrosegmenten.

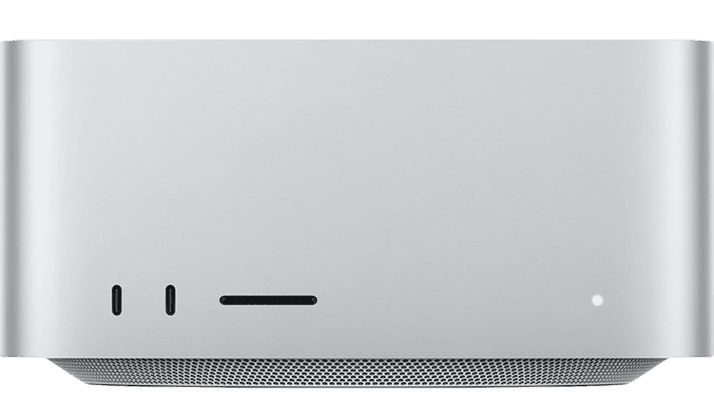

- Verschlüsselung ruhender und übertragener Daten: Secure Enclave und FileVault auf Mac Studios; mTLS für alle Modellendpunkte.

- Eingabefilter (Prompt Shielding): Eingabefilter verhindern, dass personenbezogene Daten außerhalb freigegebener Kontexte genutzt werden.

4. Rollen und Zustimmung

Ein fein abgestimmtes RBAC-Konzept ist der Kern jeder Governance. Operatoren, Verantwortliche für Anwendungsfälle und Auditoren erhalten klar abgegrenzte Rechte. Für Anfragen, die personenbezogene Daten enthalten, werden Einwilligungen dokumentiert und regelmäßig erneuert.

5. Kontinuierliche Überwachung

Selbst bei lokalen LLMs ist kein Setup statisch. Änderungen an Modellen, Kontextdaten oder Prompt-Vorlagen brauchen Impact-Analysen und Regressionstests. Monitoring auf PII-Leaks, Policy-Verstöße und Model Drift sollte verpflichtend sein. Tools wie Locaia Sentinel liefern Alerts für ungewöhnliche Zugriffsmuster oder ausbrechende Tokens.

Fazit

Datenschutzkonforme GenAI ist kein Zufallsprodukt – sie entsteht aus einer Kombination von Technik, Prozessen und stetigem Training der Mitarbeitenden. Locaia begleitet Unternehmen vom initialen Datenschutz-Assessment bis zur laufenden Überwachung, damit lokale LLMs rechtssicher und verantwortungsvoll arbeiten.